- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:45.

- Última modificación 2025-01-22 17:22.

En términos sencillos, el uno mismo - atención El mecanismo permite que las entradas interactúen entre sí (" uno mismo ”) Y averigüe a quién deberían pagar más atención para (" atención ”). Las salidas están agregados de estas interacciones y atención puntuaciones.

Además, ¿qué es la atención a uno mismo?

Uno mismo - atención , a veces llamado intra- atención es un atención mecanismo que relaciona diferentes posiciones de una sola secuencia para calcular una representación de la secuencia.

Además, ¿qué es la auto atención en el aprendizaje profundo? Primero, definamos qué " uno mismo - Atención " es. Cheng et al, en su artículo titulado “Redes de memoria a corto y largo plazo para Máquina Reading”, definido uno mismo - Atención como el mecanismo de relacionar diferentes posiciones de una sola secuencia u oración con el fin de obtener una representación más vívida.

Respecto a esto, ¿qué es el mecanismo de atención?

Mecanismo de atención permite que el decodificador preste atención a diferentes partes de la frase fuente en cada paso de la generación de salida. En lugar de codificar la secuencia de entrada en un único vector de contexto fijo, dejamos que el modelo aprenda a generar un vector de contexto para cada paso de tiempo de salida.

¿Qué es el modelo basado en la atención?

Atención - modelos basados pertenecen a una clase de modelos comúnmente llamado secuencia a secuencia modelos . El objetivo de estos modelos , como sugiere el nombre, para producir una secuencia de salida dada una secuencia de entrada que, en general, tiene diferentes longitudes.

Recomendado:

¿Cómo te etiquetas a ti mismo en una publicación en Facebook?

Escriba '@' en el punto en una actualización de estado o comentario donde desea etiquetarse y luego escriba su nombre tal como aparece en Facebook. Aparecerá una lista de personas debajo de donde está escribiendo mientras escribe

¿Qué es el ciclo de la comunicación en la atención sanitaria y social?

Los dos contextos principales en los que los trabajadores de la salud y la asistencia social utilizan el ciclo de comunicación son la comunicación individual y grupal. Los cuidadores hablan con sus compañeros de trabajo, con las personas que utilizan los servicios de cuidados y con sus familiares de forma individualizada muchas veces al día

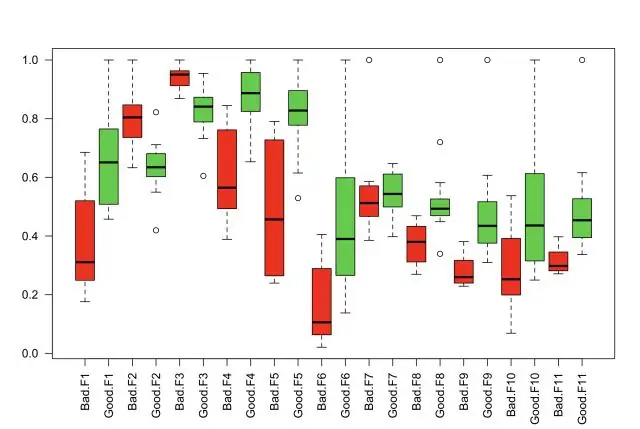

¿Cómo trazo múltiples gráficos en el mismo gráfico en R?

Varias curvas en la misma gráfica Cree la primera gráfica usando la función plot (). Para los gráficos posteriores, no utilice la función plot (), que sobrescribirá el gráfico existente. En cambio, cada una de las curvas subsiguientes se trazan usando funciones de puntos () y líneas (), cuyas llamadas son similares a plot ()

¿Por qué es importante mantener la confidencialidad de la información en la atención sanitaria y social?

Uno de los elementos más importantes de la confidencialidad es que ayuda a generar y desarrollar confianza. Potencialmente permite el libre flujo de información entre el cliente y el trabajador y reconoce que la vida personal del cliente y todos los asuntos y problemas que tiene le pertenecen

¿Se requiere uno mismo en Python?

, pero en Python' self. 'es siempre necesario. La razón es que Python no tiene una sintaxis explícita para declarar variables, por lo que no habría forma de saber si se supone que x = 7 declara una nueva variable local o un signo a una variable miembro