Tabla de contenido:

- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:45.

- Última modificación 2025-01-22 17:22.

Spark puede ser correr utilizando el programador de clúster independiente integrado en el local modo. Esto significa que todos los Chispa - chispear los procesos son correr dentro de la misma JVM, efectivamente, una única instancia multiproceso de Chispa - chispear.

En este sentido, ¿cómo ejecuto Apache Spark localmente?

Los siguientes pasos muestran cómo instalar Apache Spark

- Paso 1: Verificación de la instalación de Java.

- Paso 2: verificar la instalación de Scala.

- Paso 3: descarga de Scala.

- Paso 4: Instalar Scala.

- Paso 5: descarga de Apache Spark.

- Paso 6: Instalar Spark.

- Paso 7: Verificación de la instalación de Spark.

Además, ¿podemos ejecutar Spark sin Hadoop? Según Chispa - chispear documentación, Spark puede funcionar sin Hadoop . usted mayo ejecutarlo como modo autónomo sin cualquier administrador de recursos. Pero si usted querer correr en configuración de múltiples nodos, usted necesita un administrador de recursos como YARN o Mesos y un sistema de archivos distribuido como HDFS , S3 etc. Sí, la chispa puede funcionar sin hadoop.

Además de arriba, ¿cómo ejecuto Spark en modo independiente?

Instalar Modo autónomo de Spark , simplemente coloque una versión compilada de Chispa - chispear en cada nodo del clúster. Puede obtener versiones prediseñadas de Chispa - chispear con cada lanzamiento o constrúyalo usted mismo.

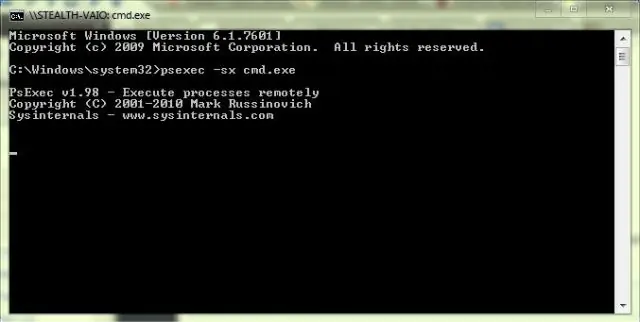

¿Se puede ejecutar Spark en Windows?

A Chispa - chispear solicitud pueden ser un Ventanas -script de shell o eso pueden ser un programa personalizado escrito en Java, Scala, Python o R. Necesita Ventanas ejecutables instalados en su sistema para correr estas aplicaciones.

Recomendado:

¿Cómo puedo ejecutar mi programa C en el símbolo del sistema?

¿Cómo compilar el programa C en el símbolo del sistema? Ejecute el comando 'gcc -v' para comprobar si tiene un compilador instalado. Cree un programa cy guárdelo en su sistema. Cambie el directorio de trabajo al lugar donde tiene su Cprogram. Ejemplo:> cd Desktop. El siguiente paso es compilar el programa. En el siguiente paso, podemos ejecutar el programa

¿Puedo ejecutar Windows y Mac en la misma PC?

Si posee una Mac basada en Intel, puede ejecutar tanto OS X como Windows en la misma computadora. La mayoría de las computadoras PC usan chips basados en Intel, lo que significa que ahora puede ejecutar los sistemas operativos Windows y OS X en una computadora Mac

¿Puedo ejecutar Python en Hadoop?

Con la posibilidad de elegir entre lenguajes de programación como Java, Scala y Python para el ecosistema Hadoop, la mayoría de los desarrolladores usan Python debido a sus bibliotecas de soporte para tareas de análisis de datos. La transmisión de Hadoop permite al usuario crear y ejecutar trabajos de Map / Reduce con cualquier script o ejecutable como mapeador y / o reductor

¿Puedo ejecutar Malwarebytes y McAfee al mismo tiempo?

Sí, Mcafee proporciona una protección sólida, pero sería bueno tener malwarebytes si cree que algo podría haber pasado furtivamente a mcafee o al producto que ha instalado. Solo se ejecuta mientras se escanea

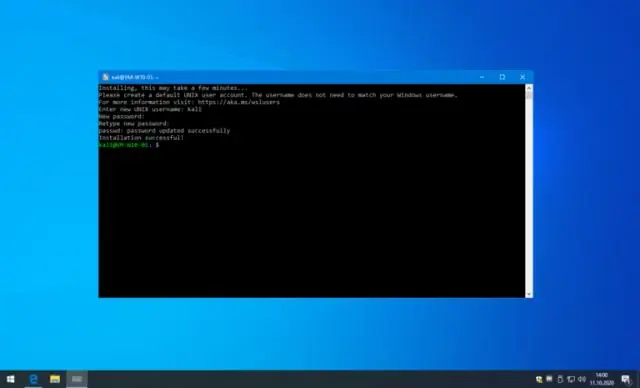

¿Puedo ejecutar MS Office en Linux?

Los usuarios de Linux pueden usar LibreOffice, GoogleDocs e incluso las aplicaciones web de Office de Microsoft, pero algunas personas aún necesitan, o simplemente quieren, la versión de escritorio de Microsoft Office. Afortunadamente, hay formas de ejecutar Microsoft Office en Linux. Obviamente, esto no es compatible con Microsoft, pero aún funciona bastante bien